德国研究人员成功展示了一种用于神经形态人工智能设计的能量效率高达30,000 TOPS/W的电容记忆技术

德国德累斯顿的马克斯普朗克微结构物理研究所和Semron的研究人员已经开发出了这种技术,可以很容易地使用传统的硅制造工艺和系统来实现,为快速商业化铺平了道路。

降低深度学习系统功耗的一种方法是使用内存计算,其中乘法和累加操作(MAC)是在内存内部进行的。一种常见的方法是使用模拟电阻式存储设备,如记忆电阻或相变存储器,其中乘法由欧姆定律实现,积累由基尔霍夫电流定律实现。

然而,电容器件具有较高的信噪比,研究人员开发了一种电荷屏蔽层,它可以通过对掺杂结施加外部电压或通过上层介电层中的非挥发性铁电存储器的影响来传输或屏蔽电场。

这使得他们能够建立一个电容存储设备的交叉阵列,以实现高度并行的矢量矩阵乘法。

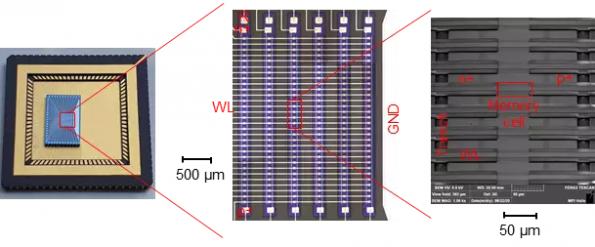

研究人员制作了一个由156个存储单元组成的原型交叉条阵列,并成功地实现了一个5x5图像识别算法,用于字母M、P和i的分类。单个设备的高动态范围为1:1478,并显示了模拟编程能力。

相关文章

Semron的首席技术官凯-乌韦·德马西乌斯说:“以往所有的电容技术要么制造不实际,要么精度低。”

详细的模拟结果表明,实验和模拟结果之间有良好的匹配,证明了可扩展性的器件小到45nm的尺寸。

使用电容存储器允许使用绝热充电,从而实现超过3500 TOPS/W的能源效率,6-8位精度。对于一种检测手写数字的算法,获得了29600 TOPS/W的能量效率

图片:

用156个memcapacit存储单元制作芯片,用于进行5x5图像识别算法