如果数据是新的油,则人工智能(AI)将数据处理到真正宝贵的资产。这是这种信念,导致AI申请的需求现在爆炸。根据普华永道和MMC Ventures的说法,AI初创公司的资金正在增加,去年达到超过90亿美元,技术初创公司有一些类型的AI组件,与他人相比有多达50%的资金。这种强烈的投资导致AI技术的快速创新和进步。但传统的AI使用模型“扫除并将其发送到云”被突破,因为延迟或能量消耗可以使传输不切实际。另一个主要挑战是,消费者越来越不舒服,他们的私人数据可能暴露在世界上。

出于这些原因,AI应用程序正在推出其正常数据中心环境,允许其智能驻留在网络边缘。因此,移动和物联网设备正在变得“更聪明”,以及各种传感器 - 特别是安全摄像机 - 在边缘占据居住。但是,这是硬件约束开始瘫痪的地方。

与传统处理器相比,增加生活在边缘的智力量需要更多的计算能力和记忆。研究已经反复表明,AI模型推理精度严格依赖于可用的硬件资源量。由于客户需要更高的准确性 - 例如,语音检测已经发展到多方面的语音和声模式识别 - 此特定问题仅继续加强随着这些AI模型的复杂性增加而加剧。

一个重要的问题只是对电力的需求。ARM预测2030年代将有1万亿连接的设备。如果每个智能设备消耗1W(安全摄像机消耗更多),那么所有这些设备都会组合将消耗1个Terawatt(TW)的电源。这不仅仅是“添加更大的电池”问题。对于上下文,美国2018年的总产生能力在1.2 TW中仅略高。这些无处不在的设备,单独微不足道,将创造一个综合电力灾难。

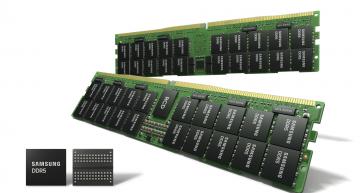

当然,目标是永远不会让力量问题到达那一点。AI开发人员正在简化其模型,硬件功率效率不断通过Moore的定律和巧妙的电路设计来改善。然而,其中一个主要挑战仍然是遗留记忆技术,SRAM和DRAM(分别静态和动态RAM)。这些存储器正在击中墙壁上的尺寸和功效,现在通常是系统功耗和成本。